|

電子情報通信学会 - IEICE会誌 試し読みサイト

© Copyright IEICE. All rights reserved.

|

|

電子情報通信学会 - IEICE会誌 試し読みサイト

© Copyright IEICE. All rights reserved.

|

解説

クロスモーダルインタラクション最前線

Recent Trends in Cross-modal Interaction Research

A bstract

人間にはある感覚の情報から,ほかの感覚の情報についても補完して認知・解釈する特性があり,そうしたクロスモーダルな錯覚現象が知覚において重要な役割を果たしていることが明らかになってきている.これらの「クロスモーダルインタラクション(感覚間相互作用)」は,そのメカニズムの解明と工学分野での活用が盛んに取り組まれている.本稿ではクロスモーダルインタラクションのメカニズムを既存研究の紹介を交えながらまとめた後,最新の研究動向の紹介を通じて今後の可能性を論じる.

キーワード:クロスモーダルインタラクション,擬似触力覚,バーチャルリアリティ

人間が周囲の環境を認識する際に得る情報は必ずしも単一の感覚のモダリティからとは限らない.視覚と聴覚,触覚等,複数のモダリティからの情報が統合され処理される.このとき人間は,最も確からしいと思える世界を脳内で再構築するために,各々のモダリティからの感覚情報をできる限り矛盾なく統合しようとする.その過程において,曖昧な情報についてはより信頼できるほかの感覚によって補完しようとする機能が働く.例えば,視聴覚間のそのような補完機能の結果として,<ba>を発音するときの口の動きに<ga>の音を同期させると<da>と聞こえるMcGurk効果のような現象が知られている(1).このような,「多感覚情報の補完機能によってある感覚における知覚が変化する現象」をクロスモーダルインタラクション(感覚間相互作用)と呼ぶ.

五感提示ディスプレイの開発が始められた当初は,五感はそれぞれ独立したものと捉えられてきた.そのため五感情報を提示するディスプレイの設計も独立に考えられ,環境や現象を再現するのに必要な感覚刺激を計測データに基づいて設計・物理的に再現し,それを各感覚に提示するアプローチがとられてきた.

一方こうしたアプローチの問題点として,解像度や分解能を上げて各感覚情報の物理的特性を忠実に計測・再現しようとすればするほど,大掛かりで複雑なシステムが必要になるトレードオフが発生するという点が挙げられる.それでも,物理現象に基づいた感覚提示である視覚や聴覚情報提示においては,こうしたアプローチに基づいたディスプレイ設計がある程度の成功を収めている.しかし,触力覚ディスプレイは比較的人工的な感覚再現が容易な視覚や聴覚のディスプレイに対し複雑・高コストになりやすく,様々な分野に需要があるにもかかわらず普及が進んでいないのが現状である.加えて,化学的反応に基づく,嗅覚や味覚の感覚提示においては,多様な感覚情報をセンシングしたり,任意の刺激を提示したりするための手法そのものがいまだに確立されていない.

五感情報提示手法が抱えるこうした問題を解決するために,クロスモーダルインタラクションの活用が着目されるようになった.認知科学や脳科学の領域において,脳内での異なる感覚の情報処理が密接に相互作用していることが明らかにされ(2),(3),Virtual Reality(VR)やHuman Computer Interaction(HCI)の分野においてもこの考え方が取り入れられてきている.本稿では,近年整理されつつあるクロスモーダルインタラクションのメカニズムを既存研究の紹介を交えながらまとめた後,最新(2017年以降)の研究動向の紹介を通じて本研究分野の今後の可能性を論じる.

2.ではクロスモーダルインタラクションの機序として着目されている感覚間一致,多感覚統合,知識や経験・記憶による解釈について,既存研究の紹介を交えながらまとめる.

感覚間一致(cross-modal correspondence)とは,異なる処理ドメインを持つ情報間に類似性・一致性を知覚する現象のことを指す.特に視聴覚間で数多くの事例が報告されており,視覚刺激の大きさや明るさと聴覚刺激の音圧・音程の高さとの感覚間一致や,物体の空間的位置と音程間の一致などが知られている(4)~(6).感覚間一致に近しい現象として,特定の知覚領域と別の知覚領域が結び付く共感覚という現象も知られている(7),(8).

感覚間一致は,95%以上の人が「ブーバ」はとがった図形よりも丸みを帯びた図形の方が合うと答えることや(9),ほとんどの人が高い音には明るい色や小さいもの,低い音には暗い色や大きなものが合うと答えることが知られており(10),こうした多くの人が持つ認知処理特性は「弱い共感覚」と位置付けられることもある.それに対し,文字に色がついて見えるような特殊な感覚は「強い共感覚」と呼ばれ,こうした感覚を持つ共感覚者と呼ばれる人々は全体で数%しかいない.後者は誘因刺激と励起感覚の具体的な対応関係に大きな個人特異性があるのに対し(11),感覚間一致,弱い共感覚は個人差が少なく大人数の人に共有されるという特徴がある.

感覚間一致には,単純な知覚属性間に生じるものから,印象評価など高次の認知処理が加わるものまで様々な種類が確認されており,そのメカニズムも構造的協応(二つの情報が共通の神経基盤で表象されることで生じるもの),統計的協応(生活環境内での統計情報が蓄積され,共起頻度の高い刺激属性の対情報が内在化することで形成されるもの),意味的協応(情報に共通の言語ラベルが与えられることで生じるもの),ヘドニック協応(共通した感情を喚起させる情報間に生じるもの)等複数あると考えられている(5),(12).

感覚間一致を活用したクロスモーダルインタラクションの研究として,物体の色と重さ知覚の関係を利用したAugmented Enduranceが挙げられる(13).人の重さに対する知覚は,力覚的な刺激のみでなく物体の大きさや色といった視覚的な刺激にも大きく影響を受けることが明らかにされている(14),(15).本研究ではこれらの知見を工学的に応用し,拡張現実感によって把持物体の明度を操作することで重さに対する知覚を変化させ,物体を持ち上げた際の疲労を軽減して持久力を向上させる手法を提案している.

感覚間一致とは異なる形での感覚モダリティ間の相互作用処理として,「異なる感覚モダリティに入力された刺激を一つの事象として知覚・認識する処理」として定義されている多感覚統合(Multi-sensory Integration)が挙げられる(16).

多感覚統合の発現には,複数の感覚器への刺激入力が時空間的な一致を伴って行われることが求められる.ただし,これまでの研究から時間,空間情報のずれに対しては一致判断の許容範囲が存在することが明らかとなっている.先に述べた感覚間一致が,意味概念的な共通性など何らかの規則性に基づいて関連する情報同士をまとめる感覚処理であるのに対し,多感覚統合は一つの事象から同時に発生した複数の感覚情報を各感覚器へ入力し,脳内で統合する感覚処理であると言える.

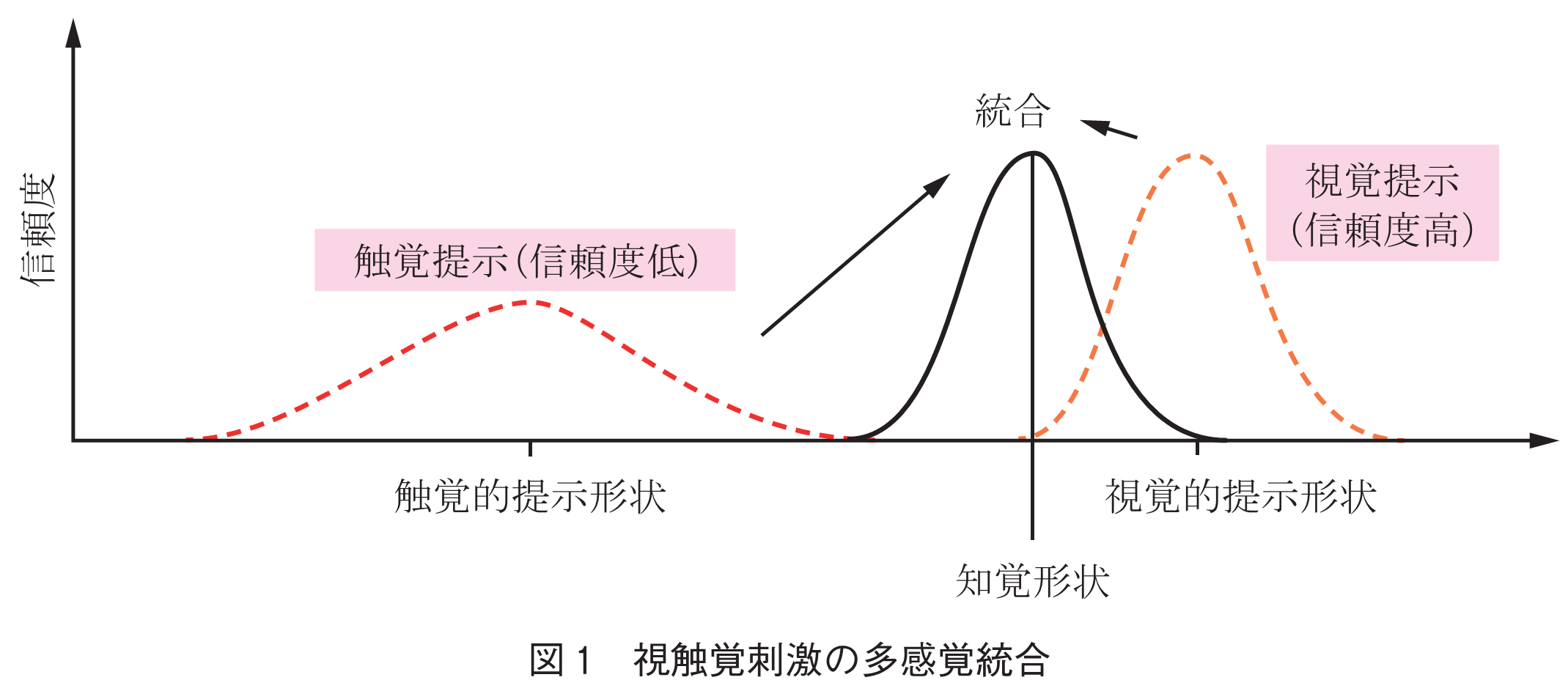

また,感覚情報の信頼性も多感覚統合に深く関連していることが知られている(17).感覚情報の信頼性は感覚モダリティの優位性とも関連があり,事象に対して優位性を持つモダリティの情報信頼性が高くなる.多感覚統合では,それぞれの感覚入力に対して最ゆう推定に基づいて重み付けが行われ,その重み付けに従った感覚情報の優位性に基づいた知覚が形成されると考えられている.各感覚情報の信頼度はその感覚が従う正規分布の分散によって決まり,感覚情報の分散が小さい場合は信頼度が高いとされる.感覚統合時の認識結果に各感覚情報が占める割合は各感覚情報の信頼度によって決まり,信頼度が高い感覚には大きい重み付けがされる(図1).

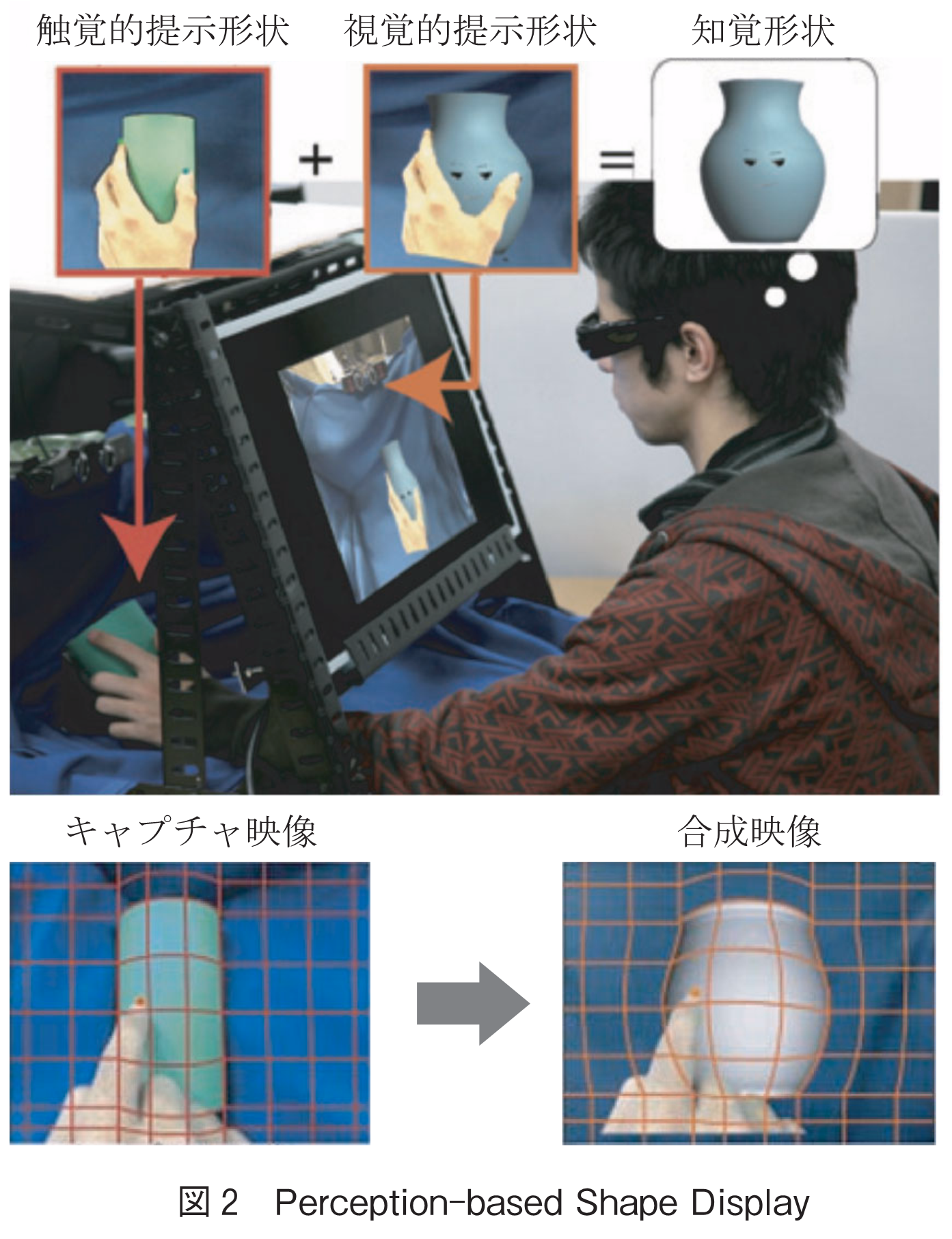

例えば,触っている物体の形状知覚を変化させるPerception-based Shape Displayでは,信頼度が高い視覚情報と信頼度の低い触覚情報を統合することで,視覚的に提示されたCGオブジェクトを触っているかのような感覚を生起させている(18),(19).本システムではユーザはビデオシースルーのモニタ越しに立体物を指で触る.図2が示すように,ユーザが実際に触れているのは円筒形の物体であるが,モニタ中には実際にモニタの裏に置かれている立体物ではなく,異なる形状のバーチャル物体が表示される.この際,実物体に触れているユーザの手の動きを取得し,その指の位置をバーチャル物体の表面形状に沿うように変化させて表示する.この視覚刺激と実際に触れている指から知覚する触覚刺激の統合により形状知覚が視覚刺激側に引っ張られ,バーチャル物体の形状を触っている知覚を生じさせることが可能になる.この例のように,クロスモーダルインタラクションの研究においては,視覚・聴覚刺激が高い信頼性を持つ感覚情報であることを利用して視聴覚刺激で触覚・嗅覚等を変化させるものが多くみられる.

他方,体験のコンテキストや記憶によって生じる期待や注意により生じるクロスモーダルインタラクションも存在する.例えば,鳴海らは拡張現実感(AR: Augmented Reality)によってプレーンクッキーの見た目と匂いを変化させる「メタクッキー」システムを開発している(20).味覚知覚に強い影響を与える嗅覚刺激と,食味の認知・ラベリングに対して影響を与えることが知られている視覚刺激の影響を利用することで,実際に口に入れるクッキーを変化させることなく,チョコレート等数種類の味をユーザに体験させることができる.この例ではチョコレートクッキーを食べた際に感じる匂いや見た目の記憶を元に視覚・嗅覚・味覚の感覚統合が行われている.

食物の見た目を操作して味印象を変化させるアプローチとしては,食品の視覚的テクスチャをリアルタイムかつ自然に画像処理変換することで他の食品に見せ,味に対する印象を変化させる手法も研究されている(21),(22).この手法により,マグロの赤身をトロの見えに変換することで赤身をトロの味に近づけたり,ブラックコーヒーの見た目をカフェオレやカフェラテにリアルタイムに変化させることでミルク感や苦みを制御できることが確かめられている.これらの手法も,トロの脂やカフェオレの甘みを経験的に知っていることで初めて効果を発揮する錯覚である.

クロスモーダルインタラクションの機序,何が知識や経験によるもので,何が感覚間一致のような生理的・発達的な基盤によるものかの境界は不明瞭な部分も多い.例えば,暖色は暖かく寒色は冷たい印象を生起するという関係は,生理的・発達的な基盤によるものと考えられてきたが,この関係は文化的な規範に基づくということが示唆されている(23).

3.と4.では視覚・聴覚刺激により知覚が変化させられることが多い,触覚・嗅覚・味覚にまつわるクロスモーダルインタラクション研究の最新動向を紹介する.

視覚・聴覚と触覚との間には強く効果の発生する錯覚現象が観察されることが古くから知られてきた.中でも,視覚と触覚の相互作用であるPseudo-hapticsは,クロスモーダルインタフェースの研究として最初期から扱われており,今に至るまで様々な研究が行われている(24).Pseudo-hapticsとは,身体動作を反映するポインタやバーチャルハンドの位置や速度を視覚的に操作することで,触力覚提示デバイスなしに擬似的な触力覚をユーザに知覚させる現象である.Pseudo-haptics効果を活用することで,重さ,抵抗感等の力覚に加えて,硬軟感等のテクスチャ感,また形状等に関する知覚の変化についても提示できることが確かめられている(18),(24)~(26).近年では,デスクトップ環境やHead Mounted Display(HMD)環境だけでなく,空中映像やプロジェクション環境においてもPseudo-hapticsの効果が確かめられている(27),(28).

Pseudo-hapticsの制約として,実身体の動作がユーザから見えてしまうケースでは錯覚効果が生起しにくいという点が挙げられる(29).これは,実身体の動作とそれを反映するポインタ等の動きの差異が可視化されることにより,ポインタに対しての行為主体感が低下するためだと考えられている(30).そのため,コンピュータマウスによりポインタを操作するデスクトップ環境やHMDを装着してバーチャルハンドを操作するVR環境に比べ,タッチスクリーン環境では錯覚効果を生起させるのが困難であった.加えて,タッチスクリーンでポインタを用いた従来のPseudo-haptics効果を実装しようとすると,ポインタが指に隠れてしまうという問題も生じる.

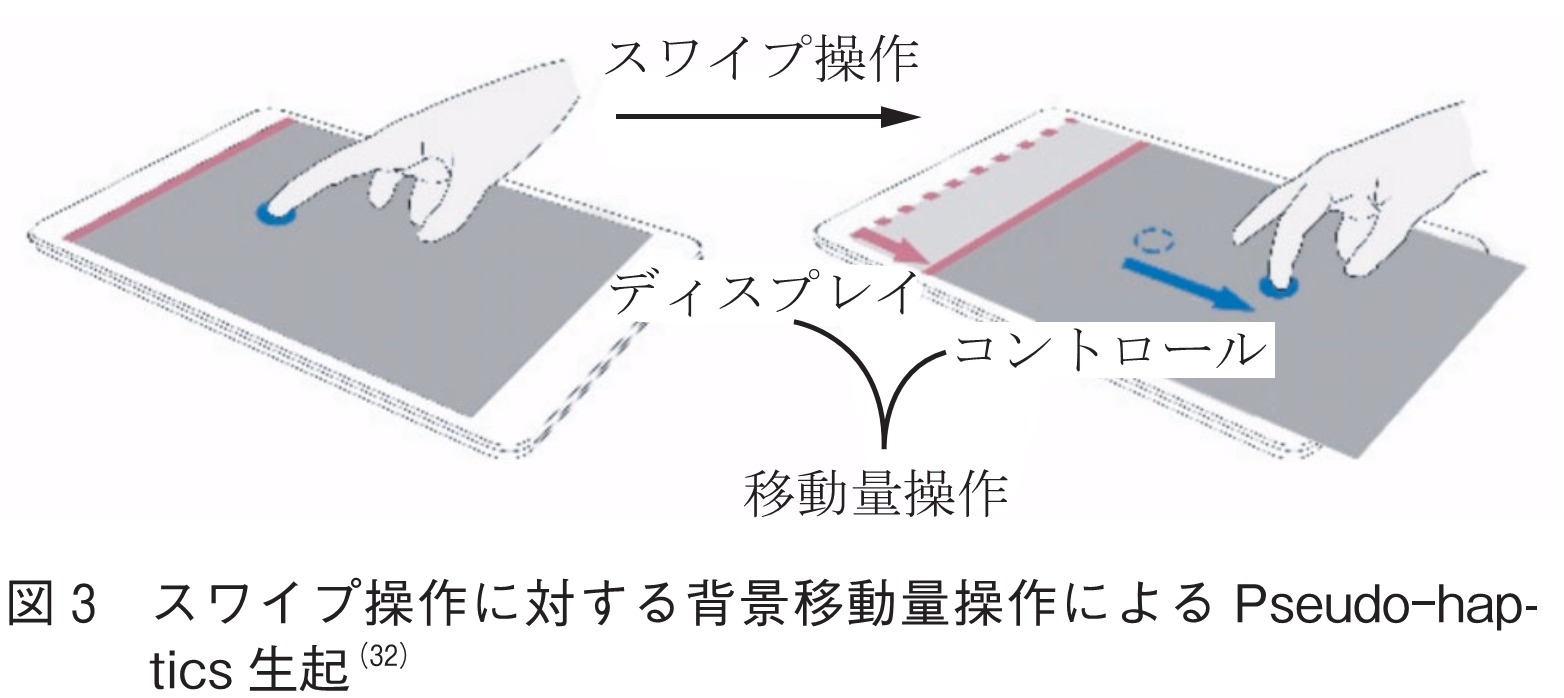

これらの問題を解決するため,宇治土公らはタッチスクリーンのスワイプ操作によって移動する背景の移動量を変化させるアプローチを提案した(図3)(31).実験の結果,指のスワイプ量に対する背景の移動量を小さくすることで擬似的な抵抗感を大きく知覚させられ,その効果は動作の反復回数が増えた際により鋭敏になること,また指がパネル上に視認されることの効果により擬似抵抗感が大きく変化することを明らかにしている.更にHashimoto et al.は,スワイプ操作とコンテンツのスクローリング量の関係を変化させることで,コンテンツの記憶のされ方を制御する手法を提案している.特定の情報の位置においてスクローリング量を小さくしてスワイプさせにくくすることで,情報に対しての記憶が強まることが明らかにされている(32).

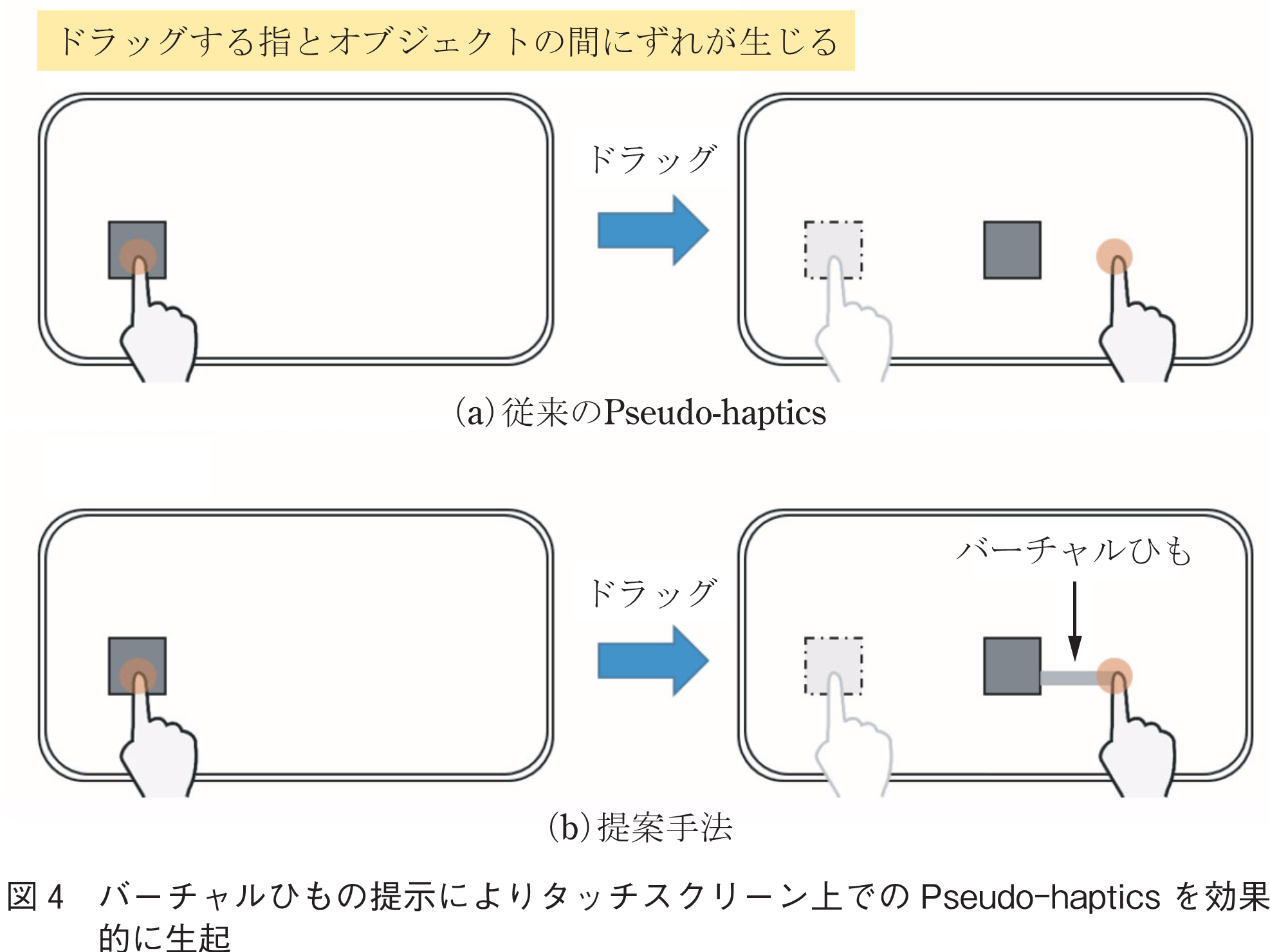

タッチスクリーンでのインタラクションにおける操作対象と指の位置のずれによるPseudo-haptics効果の低減を防ぐために,両者のずれをバーチャルなひもや輪でつなぐ手法も提案されている(33),(34).指と操作対象物体とのつながりをバーチャルなひもや輪によって明確にして,両者の位置がずれてしまっていても物体への操作感を担保することによって,両者の位置ずれによって生じる違和感を軽減するというアプローチである(図4).指とオブジェクトの間のずれを視覚的にバーチャルなひもでつなぐことに加えて,バーチャルひもがある程度の長さまで伸びた際に切断され,ドラッグができなくなる「切断エフェクト」を加えることで更にPseudo-hapticsの効果が向上することが確かめられている(33).これらの手法はタッチスクリーン入力における錯覚効果向上に寄与するだけでなく,提示すべき摩擦力が頻繁に変化し,入力と操作対象物体とのつながりが意識しにくいようなスティックスリップ現象の提示にも効果を発揮することが確かめられている(35).

2020年から始まったCOVID-19の流行に伴い,不特定多数の人が触れる可能性のある共有物に接触することがリスク視されるようになった.そのためVRの技術についても,特殊なデバイスではなく多くの人間が個々人で持っているデバイスで手軽にVR体験をできることの重要性が,社会に技術を広めていく上で高まっていると考えられる.Pseudo-hapticsは特別な触力覚提示デバイスを必要とせず,スマートフォン等広く普及している既存デバイスで提示可能なため,今後COVID-19流行下・ポストCOVID-19社会において触力覚提示技術を普及させていく上で本技術が重要な役割を果たすことが期待される.

近年盛んに研究されている視触覚間のクロスモーダルインタラクションとして,Haptic Retargetingが挙げられる(36).本手法はバーチャル環境(VE: Virtual Environment)内でバーチャルハンドの動きを変化させたり,VE全体をユーザに対して意識されない程度に回転・変形させることによって,実物体と異なる形状,若しくは異なる配置のバーチャル物体に触る体験を実現するものである.Haptic Retargetingという言葉自体は2016年にAzmandian et al.によって提唱されたものだが,その手法自体はKohliのRedirected touching(37)やBan et al.のPerception-based Shape Display(18)において部分的に実現されてきたものである.

本手法の重要な点は,実際とは異なる配置,形状のバーチャル物体にバーチャルハンドが触るタイミングと,実物体にユーザの実身体が触るタイミングをそろえること,また両タイミングをそろえるために行うバーチャルハンドの動き等の操作(マッピング)を違和感が生じない範囲で行うことである.どの程度の動きの操作であればユーザに気付かれないかについては様々な検証がなされており,動きの操作に対しての知覚しきい値がアバタの見た目の影響を受けることも報告されている.Ogawa et al.は,人間の手等のリアルなアバタは球体等の抽象的なアバタよりも,リマッピングされた動作に対して自己帰属感を生起させることができ,結果としてユーザに対してアバタの動きの操作に気付かせにくくすることを確かめている(38).

Zhao et al.は,ポイントベースの位置リターゲティングの手法や,2D形状のリマッピングや単純な3D形状の変更のための技術が中心であったHaptic Retargeting技術を拡張し,任意の実物体とバーチャル物体の対応において違和感の少ないマッピングを実現する手法を構築した(39).本手法は複数指によるインタラクションにも対応でき,マッピングの滑らかさを最大化し,実空間とバーチャル空間の間のミスマッチを最小化するようにバーチャルハンドの動きを操作することができる.

バーチャルな物体の位置・形状を提示しようとする場合,ロボットアームを用いて先端に取り付けた実物体を操作したり,アレー上に配置したピンを操作し,それらをユーザに接触させることで触力覚提示を行う遭遇型と呼ばれる手法が用いられることが主だった.振動等による接触感提示とは異なり,遭遇型ハプティックデバイスはリアリティの高い接触感を提示できるメリットがある一方,提示デバイスが長大・複雑になりがちで提示範囲・解像度もデバイスにより限定されるという課題も抱えている.Haptic Retargeting技術の発展により,そうした遭遇型デバイスを用いずともリアリティの高い接触感を提示できる可能性があるため,今後更なる発展が期待される技術だと言える.加えて近年では,遭遇型デバイスをサポートするためにHaptic Retargeting技術が活用されるケースが増えてきており,それについて3.3で紹介する.

元来物理的な触力覚提示デバイスを用いることなく擬似的な触力覚を提示できる技術として着目されてきたPseudo-hapticsやHaptic Retargetingだが,近年では触力覚提示デバイスの表現力を拡張するために用いられるケースも見られるようになってきている.Ujitoko et al.は,振動子による実振動刺激提示に,ポインタが視覚的に振動することによる擬似触覚提示を組み合わせることで,実振動刺激に対する知覚がどのように変化するかを検証した(40).実験の結果,ポインタの視覚的な振動の大きさに応じて,物理的に提示されている振動の強さに対する知覚が変化することを明らかにした.また,Abtahi et al.は,ピンアレー形の遭遇型形状提示ディスプレイの知覚性能を向上させるために,Haptic Retargetingを活用する手法を提案している(41).物理的な形状を表現するために,垂直方向に移動する作動ピンをマトリックス状に配置するピンアレー形の形状ディスプレイが提案されてきたが,解像度が低い,ディスプレイサイズが小さい,ピンの速度が低い等の制限を抱えている.そのため,実際のピン位置からずらした位置にバーチャル物体面を配置し,それに応じてバーチャルハンドの位置を操作することで,物理的に提示された形状よりも大きいバーチャル物体を知覚させたり,ピンの上下動の速度を実際よりも速く知覚させたりすることのできる手法を実現した.

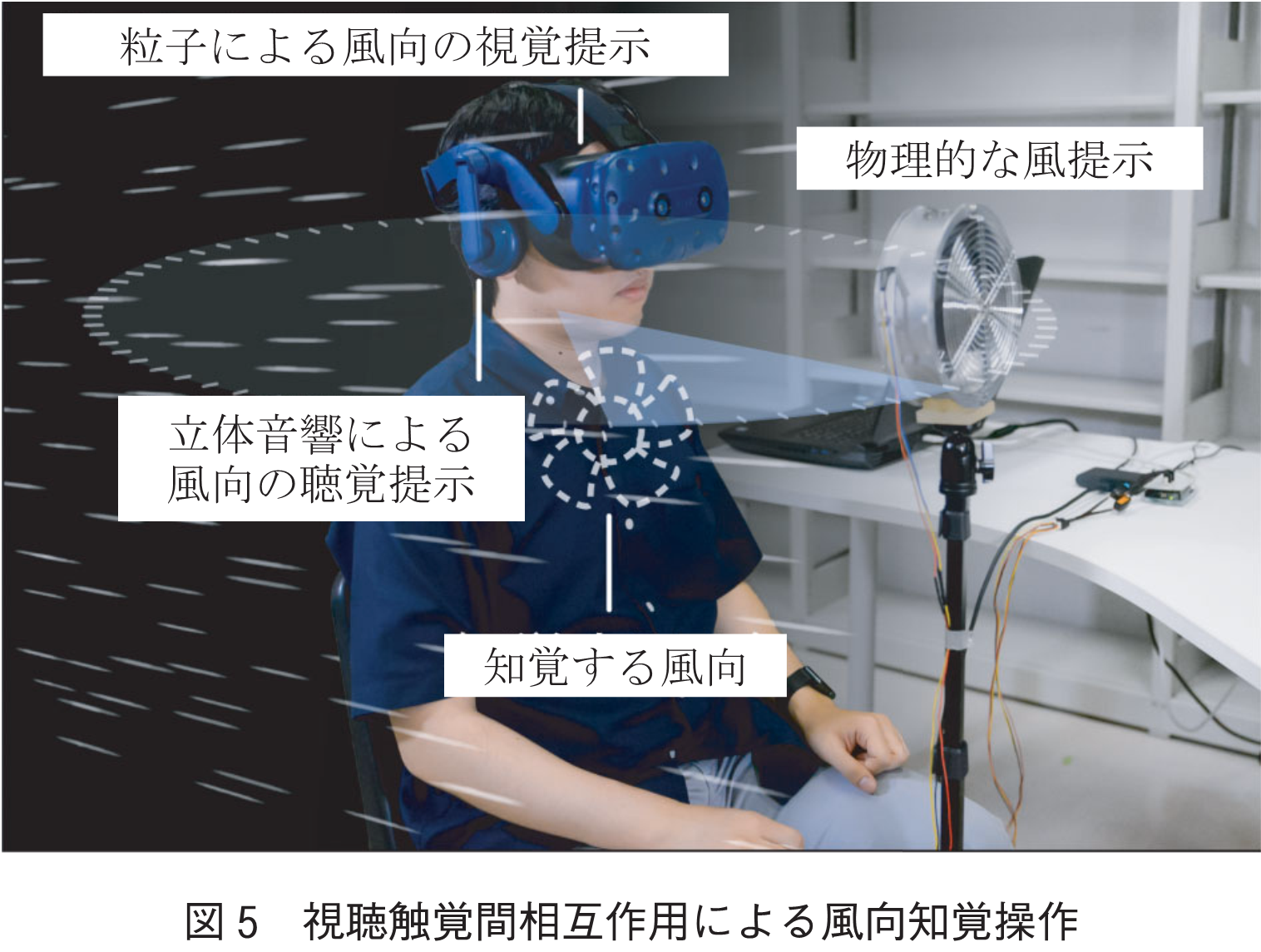

Ito et al.は,視聴覚刺激によって風の吹いてくる方向に対する知覚を変化させる手法を提案している(42).VRの研究分野において,風の感覚によって臨場感・没入感を向上させる「風覚ディスプレイ」という装置が提案されている.しかし,これまでの風覚ディスプレイには,風向を再現するために多くの風発生源(風源)を必要としてしまう課題があった.Ito, et al.は,風源の少ない風覚ディスプレイを実現するため,粒子が一定方向に流れるVR映像と立体的な風の音像を物理的な風と同時に提示して視聴触覚間相互作用を生起させることで,風向に対する知覚を操作できることを確かめた(図5).本手法により,ほぼ全周囲からの風の知覚を二つのファンのみで再現できることが実験により明らかにされている.加えて風向のほかにも,バーチャルな旗の揺らめきや落ち葉の流れ等の視覚刺激の提示により,実際に受けている風の強さに対しての知覚が変化することが確かめられている(43).これらの研究が発展していくことにより,限られた風源で多様な風感覚を提示できる風覚ディスプレイが実現することが期待される.

続いて,嗅覚・味覚提示を行うためのクロスモーダルインタラクションを紹介する.先に触れたとおりこれらの知覚は,嗅覚・味覚受容器が化学物質と結合することにより興奮・抑制の情報を中枢に伝えることで発生するものである.そのため,嗅覚・味覚情報を提示するためには,化学物質の組合せとその配合割合を考慮して提示する必要があり,安定して多様な感覚情報を提示することが難しい.こうした問題を解決するため,クロスモーダルインタラクションを活用した嗅覚・味覚提示の研究が多数行われている.

味覚に影響を与えるクロスモーダルインタラクションの研究においては,プロジェクション等を用いて視覚的に飲食物の見た目や周辺情報を操作し,味の印象を変化させる研究が多い.Ueda et al.は,ビデオシースルーなARシステムによって食品の輝度分布の標準偏差のみを操作することによって,バウムクーヘンやトマトケチャップの質感を自然に変調させる手法を提案し,視覚的に質感変調された食物を食べたときのしっとり感やおいしさを変化させられることを明らかにしている(44).

また,Nakano et al.は食品の外観を画像変換し,ARを使用して重畳することで視覚から味覚を錯覚させるGAN(Generative Adversarial Network)を用いたリアルタイム味覚操作システムを開発している(45).GANは深層学習の生成モデルの一種であり,データから特徴を学習することで実在しないデータを生成したり存在するデータの特徴に沿って変換できる.Nakano et al.はGANの中でも,顔の入力画像から髪型や年齢・性別等を変化させた顔画像を出力する等,複数ドメインの相互相関を実現するStarGAN(46)を利用し,ビデオシースルーHMD前面に取り付けられているカメラから取り込んだ食品映像を変換する手法を構築した.本手法での画像変換は元の食品の変形に応じて動的かつインタラクティブに適用され,元の食品の視覚的特徴をある程度保ちながら調整されるため,食品の見た目の変換をより自然に行うことを可能にしている.その結果,そうめんをラーメンや焼きそばに変換する等,実際に食べている食品とは違う食品を食べているかのような視覚刺激を提示でき,それにより味覚が変化することが確かめられている.

食物自体の様相を視覚的に変化させるのではなく,食物の周辺環境を変化させることにより味の印象を変化させるアプローチも研究されている.鳴海らはプロジェクションマッピングにより食環境を変容させる手法を構築し,天ぷら屋のカウンター席の前で店主が天ぷらを揚げている様子をテーブルにプロジェクションしつつ,実際の天ぷらを食べさせる実験を行った(47).その結果,プロジェクションマッピングによる食環境変化が,食にまつわる認知であるおいしさだけでなく,熱や味覚の刺激強度といった食にまつわる知覚をも変化させられることを確かめている.近年テーブルにプロジェクションを行い,食物の周辺環境の変化をも食体験に組み込むレストランも増えてきており,これらの食物や食物周辺環境の視覚的変容により味印象を変化させる取組みは研究分野・一般社会共に今後ますます展開していくと思われる.

嗅覚刺激により味の印象を変化させる手法についてもより精緻な検証が行われている.嗅覚刺激により知覚される味の強度が変化することは古くから知られており,イチゴやキャラメルの香りと甘味の関係等の相互作用が報告されている(48),(49).嗅覚受容器である嗅上皮細胞に匂い分子が到着するには,体外から鼻孔を経由する前鼻腔経路と,喉から鼻咽腔を経由する後鼻腔経路があることが知られている(50).角谷らは呼吸に同期する嗅覚提示デバイスを開発することで匂いの経路ごとに呼吸と連動して嗅覚刺激を提示できるデバイスを開発し,醤油やバニラの香りによる塩味,甘味の増強効果について検証をした(51),(52).その結果,呼気と連動して後鼻腔経路経由で提示した香りによって塩味,甘味知覚が増強され,吸気と連動した前鼻腔経由の香り提示では増強されないことを明らかにしている.

嗅覚についてのクロスモーダルインタラクションとしては,視覚刺激により匂いの種類に対する知覚を変化させる手法が考案されてきたが,近年では匂いの強度や発生源に対する知覚を視覚刺激により変化させる手法が考案されている(53),(54).Tsai et al.はHMDによって嗅覚発生源を視覚的に提示することで,匂いがどの方向からきているかについての知覚を変化させられることを確かめた.風覚提示における風源の配置と同様,嗅覚提示においても多様な方向からの匂いの提示を物理的に実現させるのはコストの面から現実的でなく,本手法によって少ない匂い提示位置で多方向からの匂いを提示できるようになれば,嗅覚ディスプレイの可能性を更に広げられると考えられる.嗅覚・味覚におけるクロスモーダルインタラクションは社会的注目度も高く,HMDに装着できる香り提示デバイスによってVR体験における匂い・味提示を行っているVAQSO等,スタートアップ企業の取組みも増加してきており,今後の更なる発展が期待される.

本稿では,クロスモーダルインタラクションのメカニズムを既存研究の紹介を交えながらまとめた後,2017年以降の最新研究動向の紹介を通じて,クロスモーダルインタラクションの可能性について述べてきた.

本稿で紹介してきたように,クロスモーダルインタラクションは研究の枠を超えて社会に取り入れられ始めているものもある一方,現段階では原理の実証研究に止まっているものも多い.実用化に向けて具体的に応用先を見付けていくためには,更に精緻な検証を行う必要がある.例えば,クロスモーダルな感覚情報提示を長時間・期間続けることによる,体験者の慣れの効果については明らかにされていない.重さ知覚を操作するPseudo-haptics効果については,錯覚の体験時間が長くなった場合にその錯覚効果が減少するという馴化の存在が報告されている(55)が,他のクロスモーダルインタラクションにおいての長期的提示の効果はまだ明らかにされていない.

また,クロスモーダル錯覚の効果量には個人差があることが報告されてきたものの,それらのばらつきについては被験者間で平均化したり中央値で評価することが主であり,個人差自体に着目しその要因を解明するところには至っていない.クロスモーダルインタラクションを感覚提示技術として工学的に活用できるようにするためには,こうした提示時間や提示対象者への依存性を解明し,安定的に効果を発揮させられる手法を構築する必要があると考えられる.今後の更なる研究によりこれらの課題が解消され,クロスモーダルインタラクションの実応用が進むことを期待する.

(1) H. McGurk and J. MacDonald, “Hearing lips and seeing voices,” Nature, vol.264, no.5588, pp.746-748, Dec. 1976.

(2) 高橋 真,谷内 通,藤田和生,“ラットはクロスモーダル知覚をするか,”動物心理学研究,vol.60, 187, 2010.

(3) N. Goda, I. Yokoi, A. Tachibana, T. Minamimoto, and H. Komatsu, “Crossmodal association of visual and haptic material properties of objects in the monkey ventral visual cortex,” Current Biology, vol.26, no.7, pp.928-934, 2016.

(4) C.J. Mondloch and D. Maurer, “Do small white balls squeak? pitch-object correspondences in young children,” Cognitive, Affective, & Behavioral Neuroscience, vol.4, no.2, pp.133-136, 2004.

(5) C. Spence, “Crossmodal correspondences: A tutorial review,” Attention, Perception, & Psychophysics, vol.73, no.4, pp.971-995, 2011.

(6) S. Dolscheid, S. Hunnius, D. Casasanto, and A. Majid, “Prelinguistic infants are sensitive to space-pitch associations found across cultures,” Psychological Science, vol.25, no.6, pp.1256-1261, 2014.

(7) G. Nixon, Review of Richard E. Cytowic,* the man who tasted shapes*, 1999.

(8) J.E. Harrison, Synaesthesia: The strangest thing, Oxford University Press, USA, 2001.

(9) V.S. Ramachandran and E.M. Hubbard, “Synaesthesia-a window into perception, thought and language,” Journal of consciousness studies, vol.8, no.12, pp.3-34, 2001.

(10) L.E. Marks, R.J. Hammeal, M.H. Bornstein, and L.B. Smith, “Perceiving similarity and comprehending metaphor,” Monographs of the Society for Research in Child Development, pp. i-100, 1987.

(11) J. Simner, “Defining synaesthesia,” British journal of psychology, vol.103, no.1, pp.1-15, 2012.

(12) O. Deroy and C. Spence, “Why we are not all synesthetes (not even weakly so),” Psychonomic bulletin & review, vol.20, no.4, pp.643-664, 2013.

(13) Y. Ban, T. Narumi, T. Fujii, S. Sakurai, J. Imura, T. Tanikawa, and M. Hirose, “Augmented endurance: controlling fatigue while handling objects by affecting weight perception using augmented reality,” Proc. the SIGCHI Conf. on Human Factors in Computing Systems, pp.69-78, 2013.

(14) A. Charpentier, “Analyse experimentale: De quelques elements de la sensation de poids,” Arch. Physiol. Normales. Pathologiques, vol.3, pp.122-135, 1891.

(15) M.C. Payne, “Apparent weight as a function of color,” The American Journal of Psychology, vol.71, no.4, pp.725-730, 1958.

(16) 横澤一彦,浅野倫子,共感覚:統合の多様性(シリーズ統合的認知),勁草書房,2020.

(17) 横澤一彦,つじつまを合わせたがる脳,岩波書店,2018.

(18) Y. Ban, T. Kajinami, T. Narumi, T. Tanikawa, and M. Hirose, “Modifying an identified curved surface shape using pseudo-haptic effect,” 2012 IEEE Haptics Symp. (HAPTICS), pp.211-216, 2012.

(19) Y. Ban, T. Narumi, T. Tanikawa, and M. Hirose, “Modifying perceived size of a handled object through hand image deformation,” Presence: Teleoperators and Virtual Environments, vol.22, no.3, pp.255-270, 2013.

(20) 鳴海拓志,谷川智洋,梶波 崇,廣瀬通孝,“メタクッキー:感覚間相互作用を用いた味覚ディスプレイの検討(<特集>香り・人・システム),”日本バーチャルリアリティ学会論文誌,vol.15, no.4, pp.579-588, 2010.

(21) J. Ueda and K. Okajima, “Ar food changer using deep learning and cross-modal effects,” 2019 IEEE Inter. Conf. on Artificial Intelligence and Virtual Reality (AIVR), pp.110-1107, 2019.

(22) C. Spence, K. Okajima, A.D. Cheok, O. Petit, and C. Michel, “Eating with our eyes: From visual hunger to digital satiation,” Brain and cognition, vol.110, pp.53-63, 2016.

(23) G.A. Morgan, F.E. Goodson, and T. Jones, “Age differences in the associations between felt temperatures and color choices,” The American journal of psychology, pp.125-130, 1975.

(24) A. Lécuyer, “Simulating haptic feedback using vision: A survey of research and applications of pseudo-haptic feedback,” Presence: Teleoperators and Virtual Environments, vol.18, no.1, pp.39-53, 2009.

(25) Y. Taima, Y. Ban, T. Narumi, T. Tanikawa, and M. Hirose, “Controlling fatigue while lifting objects using pseudo-haptics in a mixed reality space,” 2014 IEEE Haptics Symp. (HAPTICS), pp.175-180, 2014.

(26) Y. Ban, T. Narumi, T. Tanikawa, and M. Hirose, “Controlling perceived stiffness of pinched objects using visual feedback of hand deformation,” 2014 IEEE Haptics Symp. (HAPTICS), pp.557-562, 2014.

(27) Y. Osato and N. Koizumi, “Charrot: Pseudo-haptics with mid-air cg character and small robot,” Proc. the Virtual Reality Inter. Conf.-Laval Virtual, pp.1-5, 2018.

(28) 佐藤優志,平木剛史,田辺育暉,松倉 悠,岩井大輔,佐藤宏介,“投影バーチャルハンドインタフェースへの疑似触覚の適用に関する一考察,”情処学コンピュータビジョンとイメージメディア(CVIM)研報, no.8, 2018.

(29) A. Pusch and A. Lécuyer, “Pseudo-haptics: from the theoretical foundations to practical system design guidelines,” Proc. the 13th inter. conf. on multimodal interfaces, pp.57-64, 2011.

(30) A. Kokubun, Y. Ban, T. Narumi, T. Tanikawa, and M. Hirose, “Representing normal and shearing forces on the mobile device with visuo-haptic interaction and a rear touch interface,” 2014 IEEE Haptics Symp. (HAPTICS), pp.415-420, 2014.

(31) 宇治土公雄介,鳴海拓志,伴 祐樹,谷川智洋,広田光一,廣瀬通孝,“背景移動量操作を利用した視触覚間相互作用生起によるタッチパネルでの擬似触力覚提示,”日本バーチャルリアリティ学会論文誌,vol.22, no.3, pp.305-313, 2017.

(32) T. Hashimoto, T. Narumi, R. Nagao, T. Tanikawa, and M. Hirose, “Effect of pseudo-haptic feedback on touchscreens on visual memory during image browsing,” Inter. Conf. on Human Haptic Sensing and Touch Enabled Computer Applications, pp.551-563, Springer, 2018.

(33) Y. Ban and Y. Ujitoko, “Enhancing the pseudo-haptic effect on the touch panel using the virtual string,” 2018 IEEE Haptics Symp. (HAPTICS), pp.278-283, 2018.

(34) A. Costes, F. Argelaguet, F. Danieau, P. Guillotel, and A. Lécuyer, “Touchy: A visual approach for simulating haptic effects on touchscreens,” Frontiers in ICT, vol.6, p.1, 2019.

(35) Y. Ujitoko, Y. Ban, and K. Hirota, “Presenting static friction sensation at stick-slip transition using pseudo-haptic effect,” 2019 IEEE World Haptics Conf., pp.181-186, 2019.

(36) M. Azmandian, M. Hancock, H. Benko, E. Ofek, and A.D. Wilson, “Haptic retargeting: Dynamic repurposing of passive haptics for enhanced virtual reality experiences,” Proc. the 2016 chi conf. human factors in computing systems, pp.1968-1979, 2016.

(37) L. Kohli, M.C. Whitton, and F.P. Brooks, “Redirected touching: The effect of warping space on task performance,” 2012 IEEE Sym. 3D User Interfaces (3DUI), pp.105-112, 2012.

(38) N. Ogawa, T. Narumi, and M. Hirose, “Effect of avatar appearance on detection thresholds for remapped hand movements,” IEEE Trans. Vis. Comput. Graphics, 2020.

(39) Y. Zhao and S. Follmer, “A functional optimization based approach for continuous 3d retargeted touch of arbitrary, complex boundaries in haptic virtual reality,” Proc. the 2018 CHI Conference on Human Factors in Computing Systems, pp.1-12, 2018.

(40) Y. Ujitoko, Y. Ban, and K. Hirota, “Modulating fine roughness perception of vibrotactile textured surface using pseudo-haptic effect,” IEEE Trans. Vis. Comput. Graphics, vol.25, no.5, pp.1981-1990, 2019.

(41) P. Abtahi and S. Follmer, “Visuo-haptic illusions for improving the perceived performance of shape displays,” Proc. the 2018 CHI Conference on Human Factors in Computing Systems, pp.1-13, 2018.

(42) K. Ito, Y. Ban, and S. Warisawa, “Manipulating the perceived directions of wind by visuo-audio-haptic cross-modal effects,” Inter. Conf. Human Haptic Sensing and Touch Enabled Computer Applications, pp.235-243, Springer, 2020.

(43) 西牧侑哉,郷田直一,蒲池みゆき,“Vr環境下での風の強さ知覚における視触覚統合,”日本バーチャルリアリティ学会論文誌,vol.26, no.1, pp.14-21, 2021.

(44) J. Ueda, C. Spence, and K. Okajima, “Effects of varying the standard deviation of the luminance on the appearance of food, flavour expectations, and taste/flavour perception,” Scientific reports, vol.10, no.1, pp.1-12, 2020.

(45) K. Nakano, D. Horita, N. Sakata, K. Kiyokawa, K. Yanai, and T. Narumi, “Deeptaste: Augmented reality gustatory manipulation with gan-based real-time food-to-food translation,” 2019 IEEE Inter. Symp. Mixed and Augmented Reality (ISMAR), pp.212-223, 2019.

(46) Y. Choi, M. Choi, M. Kim, J. Ha, S. Kim, and J. Choo, “Stargan: Unified generative adversarial networks for multi-domain image-to-image translation,” Proc. the IEEE conf. on computer vision and pattern recognition, pp.8789-8797, 2018.

(47) 鳴海拓志,松尾宇人,櫻井 翔,谷川智洋,廣瀬通孝,“食卓へのプロジェクションマッピングによる食の知覚と認知の変容:~天ぷらを例題として~,”日本バーチャルリアリティ学会論文誌,vol.23, no.2, pp.65-74, 2018.

(48) H.N. Schifferstein and P.W. Verlegh, “The role of congruency and pleasantness in odor-induced taste enhancement,” Acta psychologica, vol.94, no.1, pp.87-105, 1996.

(49) R.J. Stevenson, J. Prescott, and R.A. Boakes, “Confusing tastes and smells: how odours can influence the perception of sweet and sour tastes,” Chemical senses, vol.24, no.6, pp.627-635, 1999.

(50) M. Espinosa Diaz, “Comparison between orthonasal and retronasal flavour perception at different concentrations,” Flavour and Fragrance Journal, vol.19, no.6, pp.499-504, 2004.

(51) 角谷雄哉,鳴海拓志,小早川 達,河合崇行,日下部裕子,國枝里美,和田有史,“呼吸と連動した醤油の匂い提示による塩味増強効果,”日本バーチャルリアリティ学会論文誌,vol.24, no.1, pp.77-82, 2019.

(52) Y. Kakutani, T. Narumi, T. Kobayakawa, T. Kawai, Y. Kusakabe, S. Kunieda, and Y. Wada, “Taste of breath: the temporal order of taste and smell synchronized with breathing as a determinant for taste and olfactory integration,” Scientific reports, vol.7, no.1, pp.1-9, 2017.

(53) 有賀安央衣,坂内祐一,妹尾武治,“Hmd提示によるベクション刺激と嗅覚刺激の知覚的相互作用に関する検討,”日本バーチャルリアリティ学会論文誌,vol.24, no.4, pp.361-370, 2019.

(54) S.-E. Tsai, W.-L. Tsai, T.-Y. Pan, C.-M. Kuo, and M.-C. Hu, “Does virtual odor representation influence the perception of olfactory intensity and directionality in vr?,” IEEE VR, pp.212-223, 2021.

(55) 伊藤健太,伴 祐樹,割澤伸一,“Pseudo-haptics重量知覚に及ぼす馴化の影響解明,”ロボティクス・メカトロニクス講演会講演概要集2020,一般財団法人日本機械学会,pp.1P1-N12, 2020.

(2021年4月16日受付 2021年5月18日最終受付)

オープンアクセス以外の記事を読みたい方は、以下のリンクより電子情報通信学会の学会誌の購読もしくは学会に入会登録することで読めるようになります。 また、会員になると豊富な豪華特典が付いてきます。

電子情報通信学会 - IEICE会誌はモバイルでお読みいただけます。

電子情報通信学会 - IEICE会誌アプリをダウンロード